- 品牌

- Nvidia

- 型号

- H100

- 磁盘阵列

- Raid10

- CPU类型

- Intel Platinum 8558 48 核

- CPU主频

- 2.10

- 内存类型

- 64G

- 硬盘容量

- Samsung PM9A3 7.6TB NVMe *8

- 厂家

- SuperMicro

- 标配CPU个数

- 2个

- 最大CPU个数

- 4个

- 内存容量

- 64G*32

- GPU

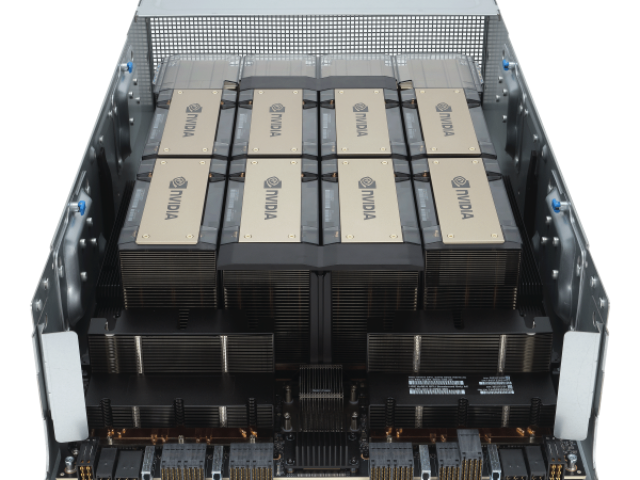

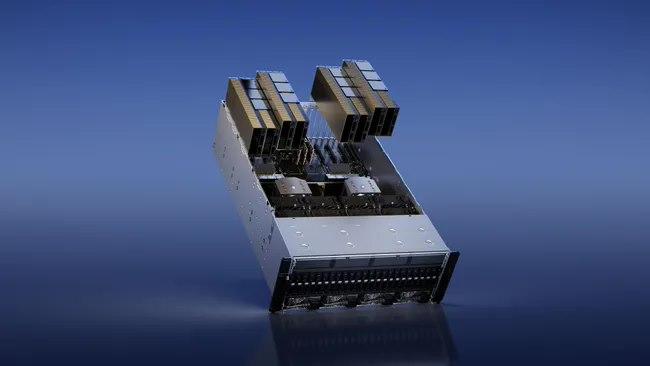

- 8 H100 80GB NVlink

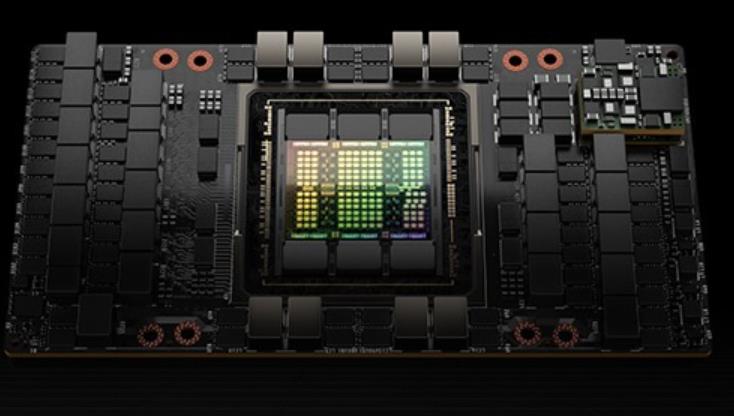

每个GPU实例在整个内存系统中都有单独的和孤立的路径--片上的交叉开关端口、L2缓存库、内存控制器和DRAM地址总线都是分配给单个实例的。这保证了单个用户的工作负载可以以可预测的吞吐量和延迟运行,具有相同的L2缓存分配和DRAM带宽,即使其他任务正在冲击自己的缓存或使其DRAM接口饱和。H100MIG改进:提供完全安全的、云原生的多租户、多用户的配置。Transformer引擎Transformer模型是当今从BERT到GPT-3使用的语言模型的支柱,需要巨大的计算资源。第四代NVLink和NVLink网络PCIe以其有限的带宽形成了一个瓶颈。为了构建强大的端到端计算平台,需要更快速、更可扩展的NVLink互连。NVLink是NVIDIA公司推出的高带宽、高能效、低延迟、无损的GPU-to-GPU互连。其中包括弹性特性,如链路级错误检测和数据包重放机制,以保证数据的成功传输。新的NVLink为多GPUIO和共享内存访问提供了900GB/s的总带宽,为PCIeGen5提供了7倍的带宽。A100GPU中的第三代NVLink在每个方向上使用4个差分对(4个通道)来创建单条链路,在每个方向上提供25GB/s的有效带宽,而第四代NVLink在每个方向上使用2个高速差分对来形成单条链路,在每个方向上也提供25GB/s的有效带宽。引入了新的NVLink网络互连。H100 GPU 具备高效的数据传输能力。订购H100GPU促销

H100 GPU 的价格动态反映了市场对高性能计算设备的强烈需求。近年来,随着人工智能、深度学习和大数据分析等领域的快速发展,H100 GPU 的市场需求量大幅增加,导致其价格持续攀升。此外,全球芯片短缺和供应链问题进一步加剧了 H100 GPU 价格的波动。尽管如此,随着技术的进步和供应链的优化,H100 GPU 的生产成本有望逐步降低,从而带动市场价格的回落。然而,在短期内,H100 GPU 的价格仍将保持在一个较高的水平。H100 GPU 的市场价格受多种因素影响,近期价格波动明显。由于 H100 GPU 拥有的计算性能和广泛的应用前景,市场需求旺盛,推动了价格的上涨。此外,全球供应链紧张和半导体短缺也对 H100 GPU 的价格造成了影响,导致其市场价格居高不下。然而,随着市场逐渐稳定和供应链的改善,预计 H100 GPU 的价格将逐步趋于合理。对于企业和研究机构而言,了解 H100 GPU 的价格动态有助于制定更加合理的采购策略,以获取比较好的性价比。CPUH100GPU distributorH100 GPU 提供高效的 GPU 直连技术。

因此线程可以自由地执行其他**的工作。②终线程需要其他所有线程产生的数据。在这一点上,他们做一个"等待",直到每个线程都有"抵达"的信号。-***是允许提前到达的线程在等待时执行**的工作。-等待的线程会在共享内存中的屏障对象上自转(spin)(我理解的就是这些等待的线程在等待的时候无法执行其他工作)也是一个分裂的屏障,但不对到达的线程计数,同时也对事务进行计数。为写入共享内存引入一个新的命令,同时传递要写入的数据和事务计数。事务计数本质上是对字节计数异步事务屏障会在W**t命令处阻塞线程,直到所有生产者线程都执行了一个Arrive,所有事务计数之和达到期望值。异步事务屏障是异步内存拷贝或数据交换的一种强有力的新原语。集群可以进行线程块到线程块通信,进行隐含同步的数据交换,集群能力建立在异步事务屏障之上。H100HBM和L2cache内存架构HBM存储器由内存堆栈组成,位于与GPU相同的物理封装上,与传统的GDDR5/6内存相比,提供了可观的功耗和面积节省,允许更多的GPU被安装在系统中。

在大数据分析领域,H100 GPU 展现了其强大的数据处理能力。它能够快速处理和分析海量数据,提供实时的分析结果,帮助企业做出更快的决策。无论是在金融分析、市场预测还是用户行为分析中,H100 GPU 都能提升数据处理速度和分析准确性。其高能效设计不仅提升了性能,还为企业节省了大量的能源成本,成为大数据分析的理想硬件。H100 GPU 在云计算中的应用也非常多。它的高并行处理能力和大带宽内存使云计算平台能够高效地处理大量并发任务,提升整体服务质量。H100 GPU 的灵活性和易管理性使其能够轻松集成到各种云计算架构中,满足不同客户的需求。无论是公共云、私有云还是混合云环境,H100 GPU 都能提供强大的计算支持,推动云计算技术的发展和普及。H100 GPU 支持 NVIDIA NVLink 技术。

英伟达可以纯粹提高价格以找到清算价格,并且在某种程度上正在这样做。但重要的是要知道,终H100的分配取决于Nvidia更喜欢将分配分配给谁。供应H100显卡#造成瓶颈的原因-供应生产方面的瓶颈是什么?哪些组件?谁生产它们?谁制造了H100?#台积电。英伟达可以使用其他芯片厂进行H100生产吗?#不是真的,至少现在还没有。他们过去曾与三星合作过。但在H100和其他5nmGPU上,他们只使用台积电。这意味着三星还不能满足他们对前列GPU的需求。他们将来可能会与英特尔合作,并再次与三星合作,但这些都不会在短期内以有助于H100供应紧缩的方式发生。不同的台积电节点如何关联?#台积电5nm系列:N5264N要么适合作为N5的增强版本,要么低于N5PN5P4N要么适合作为N5P的增强版本,要么低于N5作为N5的增强版本N4N4PH100是在哪个台积电节点上制造的?#台积电4N。这是Nvidia的一个特殊节点,它属于5nm系列,并且是增强的5nm,而不是真正的4nm。还有谁使用该节点?#是苹果,但他们主要转向N3,并保留了大部分N3容量。高通和AMD是N5家族的其他大客户。A100使用哪个台积电节点?#N727晶圆厂产能通常提前多久预留?#不确定,虽然可能是12+个月。H100 GPU 适用于虚拟现实开发。MacowH100GPU总代

H100 GPU 在游戏开发中提升视觉效果。订购H100GPU促销

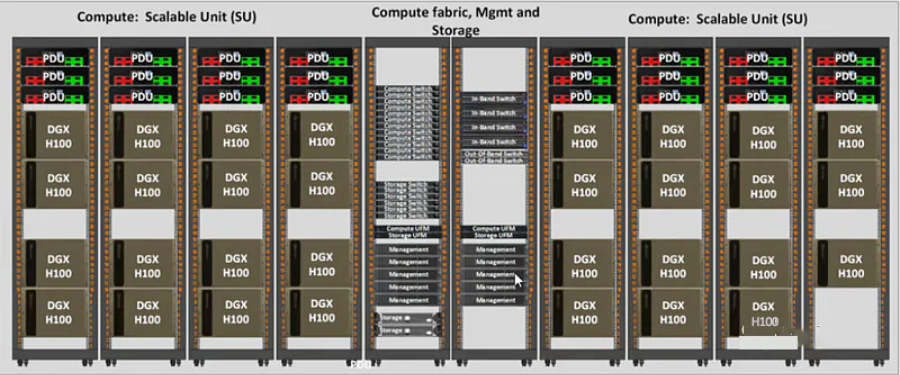

–私有云执行官什么时候会有H100继任者?#可能要到2024年底(2024年中期到2025年初)才会公布,基于Nvidia架构之间的历史时间。在此之前,H100将成为NvidiaGPU的前列产品。(GH200和DGXGH200不算在内,它们不是纯GPU,它们都使用H100作为他们的GPU)会有更高的显存H100吗?#也许是液冷120GBH100s。短缺何时结束?#与我交谈过的一个团体提到,它们实际上在2023年底之前已售罄。采购H100#谁卖H100?#戴尔,HPE,联想,Supermicro和Quanta等OEM销售H100和HGXH100。30当你需要InfiniBand时,你需要直接与Nvidia的Mellanox交谈。31因此,像CoreWeave和Lambda这样的GPU云从OEM购买,然后租给初创公司。超大规模企业(Azure,GCP,AWS,Oracle)更直接地与Nvidia合作,但他们通常也与OEM合作。即使对于DGX,您仍然会通过OEM购买。您可以与英伟达交谈,但您将通过OEM购买。您不会直接向Nvidia下订单。交货时间如何?#8-GPUHGX服务器上的提前期很糟糕,而4-GPUHGX服务器上的提前期很好。每个人都想要8-GPU服务器!如果一家初创公司***下订单,他们什么时候可以访问SSH?#这将是一个交错的部署。假设这是一个5,000GPU的订单。他们可能会在2-000个月内获得4,000或4,5个。订购H100GPU促销

- 技嘉H100GPU货期 2024-11-15

- 硬盘H100GPU优惠 2024-11-15

- Dubai戴尔H100GPU 2024-11-15

- LenovoH100GPU distributor 2024-11-15

- 北京H100GPU 2024-11-15

- 英伟达H100GPU货期 2024-11-15

- NVLINKH100GPU list price 2024-11-14

- QatarH100GPU stock 2024-11-14

- 河南H100GPU库存 2024-11-14

- 广东H100GPU 2024-11-14

- 技嘉H100GPU多少钱 2024-11-14

- CPUH100GPU多少钱 2024-11-14