- 品牌

- Nvidia

- 型号

- H100

- 磁盘阵列

- Raid10

- CPU类型

- Intel Platinum 8558 48 核

- CPU主频

- 2.10

- 内存类型

- 64G

- 硬盘容量

- Samsung PM9A3 7.6TB NVMe *8

- 厂家

- SuperMicro

- 标配CPU个数

- 2个

- 最大CPU个数

- 4个

- 内存容量

- 64G*32

- GPU

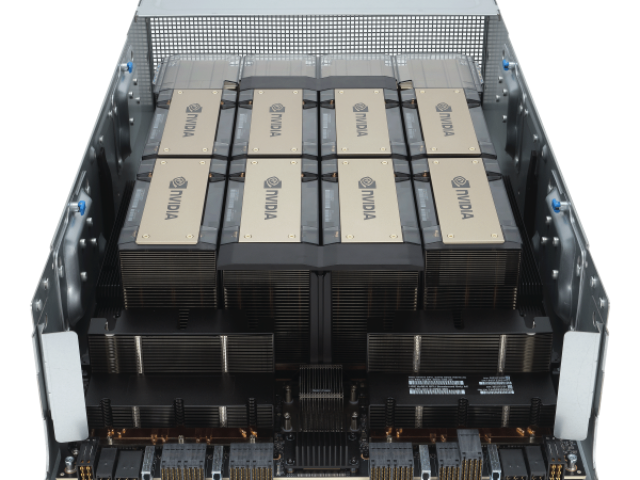

- 8 H100 80GB NVlink

H100 GPU 是英伟达推出的一款高性能图形处理器,旨在满足当今数据密集型计算任务的需求。它采用新的架构,具备强大的计算能力和能效比,能够提升各种计算任务的效率和速度。无论是在人工智能、科学计算还是大数据分析领域,H100 GPU 都能提供良好的性能和可靠性。其并行处理能力和高带宽内存确保了复杂任务的顺利进行,是各类高性能计算应用的良好选择。H100 GPU 拥有先进的散热设计,确保其在长时间高负荷运行时依然能够保持稳定和高效。对于需要长时间运行的大规模计算任务来说,H100 GPU 的可靠性和稳定性尤为重要。它的设计不仅考虑了性能,还兼顾了散热和能效,使其在保持高性能的同时,依然能够节省能源成本。无论是企业级应用还是科学研究,H100 GPU 都能够为用户提供持续的高性能支持。H100 GPU 优惠促销,马上下单。AmericaH100GPU促销价

L2CacheHBM3内存控制器GH100GPU的完整实现8GPUs9TPCs/GPU(共72TPCs)2SMs/TPC(共144SMs)128FP32CUDA/SM4个第四代张量/SM6HBM3/HBM2e堆栈,12个512位内存控制器60MBL2Cache第四代NVLink和PCIeGen5H100SM架构引入FP8新的Transformer引擎新的DPX指令H100张量架构专门用于矩阵乘和累加(MMA)数学运算的高性能计算,为AI和HPC应用提供了开创性的性能。H100中新的第四代TensorCore架构提供了每SM的原始稠密和稀疏矩阵数学吞吐量的两倍支持FP8、FP16、BF16、TF32、FP64、INT8等MMA数据类型。新的TensorCores还具有更**的数据管理,节省了高达30%的操作数交付能力。FP8数据格式与FP16相比,FP8的数据存储需求减半,吞吐量提高一倍。新的TransformerEngine(在下面的章节中进行阐述)同时使用FP8和FP16两种精度,以减少内存占用和提高性能,同时对大型语言和其他模型仍然保持精度。用于加速动态规划(“DynamicProgramming”)的DPX指令新引入的DPX指令为许多DP算法的内循环提供了高等融合操作数的支持,使得动态规划算法的性能相比于AmpereGPU高提升了7倍。L1数据cache和共享内存结合将L1数据cache和共享内存功能合并到单个内存块中简化了编程。MacowSupermicroH100GPUH100 GPU 提供高效的功耗管理。

H100GPU层次结构和异步性改进关键数据局部性:将程序数据尽可能的靠近执行单元异步执行:寻找的任务与内存传输和其他事物重叠。目标是使GPU中的所有单元都能得到充分利用。线程块集群(ThreadBlockClusters)提出背景:线程块包含多个线程并发运行在单个SM上,这些线程可以使用SM的共享内存与快速屏障同步并交换数据。然而,随着GPU规模超过100个SM,计算程序变得更加复杂,线程块作为编程模型中***表示的局部性单元不足以大化执行效率。Cluster是一组线程块,它们被保证并发调度到一组SM上,其目标是使跨多个SM的线程能够有效地协作。GPC:GPU处理集群,是硬件层次结构中一组物理上总是紧密相连的子模块。H100中的集群中的线程在一个GPC内跨SM同时运行。集群有硬件加速障碍和新的访存协作能力,在一个GPC中SM的一个SM-to-SM网络提供集群中线程之间快速的数据共享。分布式共享内存(DSMEM)通过集群,所有线程都可以直接访问其他SM的共享内存,并进行加载(load)、存储(store)和原子(atomic)操作。SM-to-SM网络保证了对远程DSMEM的快速、低延迟访问。在CUDA层面。集群中所有线程块的所有DSMEM段被映射到每个线程的通用地址空间中。

视频编辑需要处理大量的图像和视频数据,H100 GPU 的强大计算能力为此类任务提供了极大的便利。其高带宽内存和并行处理能力能够快速渲染和编辑高分辨率视频,提升工作效率。无论是实时预览、处理还是多层次剪辑,H100 GPU 都能流畅应对,减少卡顿和渲染时间。其高能效设计和稳定性确保了视频编辑过程的顺利进行,使其成为视频编辑领域的理想选择。H100 GPU 的并行处理能力和高带宽内存确保了复杂任务的顺利进行。其在视频编辑中的应用不仅提升了工作效率,还显著提高了视频质量,使得创意工作更加轻松和高效。H100 GPU 适用于大数据分析任务。

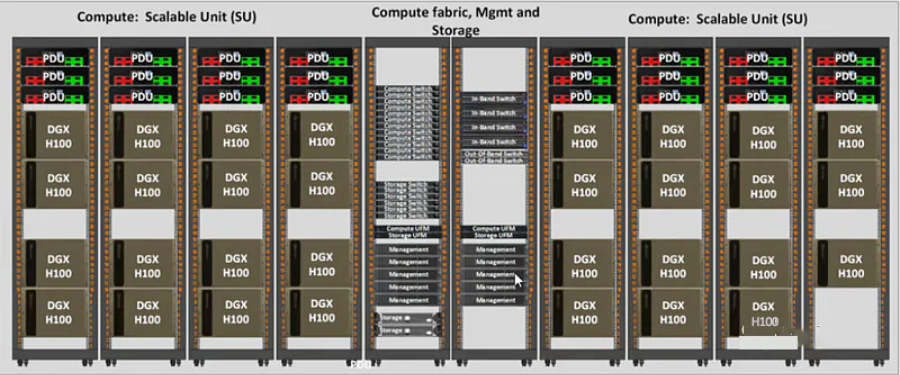

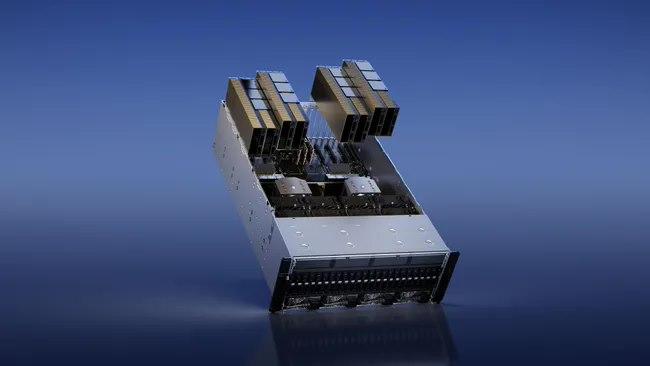

利用 NVIDIA H100 Tensor GPU,提供所有工作负载前所未有的效能、可扩展性和安全性。 使用 NVIDIA® NVLink® Switch 系统,比较高可连接 256 个 H100 来加速百万兆级工作负载,此外还有的 Transformer Engine,可解决一兆参数语言模型。 H100 所结合的技术创新,可加速大型语言模型速度,比前一代快上 30 倍,提供业界的对话式人工智能。英伟达 DGX SuperPOD架构采用英伟达的NVLink和NVSwitch系统,多可连接32个DGX节点,共256个H100 GPU。这是一个真正的人工智能基础设施平台;英伟达的DGX SuperPOD数据中心设计[4]让我们对真正的企业人工智能基础设施的巨大功率和冷却需求有了一些了解。H100 GPU 提供高效的 GPU 直连技术。湖南H100GPU how much

H100 GPU 的增强时钟频率可达 1665 MHz。AmericaH100GPU促销价

–私有云执行官什么时候会有H100继任者?#可能要到2024年底(2024年中期到2025年初)才会公布,基于Nvidia架构之间的历史时间。在此之前,H100将成为NvidiaGPU的前列产品。(GH200和DGXGH200不算在内,它们不是纯GPU,它们都使用H100作为他们的GPU)会有更高的显存H100吗?#也许是液冷120GBH100s。短缺何时结束?#与我交谈过的一个团体提到,它们实际上在2023年底之前已售罄。采购H100#谁卖H100?#戴尔,HPE,联想,Supermicro和Quanta等OEM销售H100和HGXH100。30当你需要InfiniBand时,你需要直接与Nvidia的Mellanox交谈。31因此,像CoreWeave和Lambda这样的GPU云从OEM购买,然后租给初创公司。超大规模企业(Azure,GCP,AWS,Oracle)更直接地与Nvidia合作,但他们通常也与OEM合作。即使对于DGX,您仍然会通过OEM购买。您可以与英伟达交谈,但您将通过OEM购买。您不会直接向Nvidia下订单。交货时间如何?#8-GPUHGX服务器上的提前期很糟糕,而4-GPUHGX服务器上的提前期很好。每个人都想要8-GPU服务器!如果一家初创公司***下订单,他们什么时候可以访问SSH?#这将是一个交错的部署。假设这是一个5,000GPU的订单。他们可能会在2-000个月内获得4,000或4,5个。AmericaH100GPU促销价

- 技嘉H100GPU货期 2024-11-15

- 硬盘H100GPU优惠 2024-11-15

- Dubai戴尔H100GPU 2024-11-15

- LenovoH100GPU distributor 2024-11-15

- 北京H100GPU 2024-11-15

- 英伟达H100GPU货期 2024-11-15

- NVLINKH100GPU list price 2024-11-14

- QatarH100GPU stock 2024-11-14

- 河南H100GPU库存 2024-11-14

- 广东H100GPU 2024-11-14

- 技嘉H100GPU多少钱 2024-11-14

- CPUH100GPU多少钱 2024-11-14