- 品牌

- Nvidia

- 型号

- H100

- 磁盘阵列

- Raid10

- CPU类型

- Intel Platinum 8558 48 核

- CPU主频

- 2.10

- 内存类型

- 64G

- 硬盘容量

- Samsung PM9A3 7.6TB NVMe *8

- 厂家

- SuperMicro

- 标配CPU个数

- 2个

- 最大CPU个数

- 4个

- 内存容量

- 64G*32

- GPU

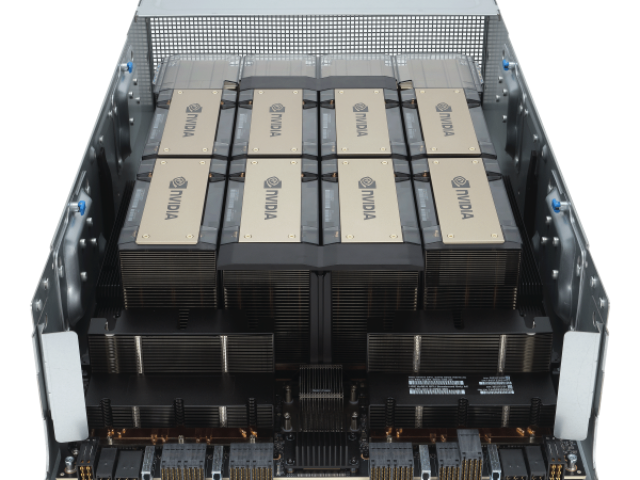

- 8 H100 80GB NVlink

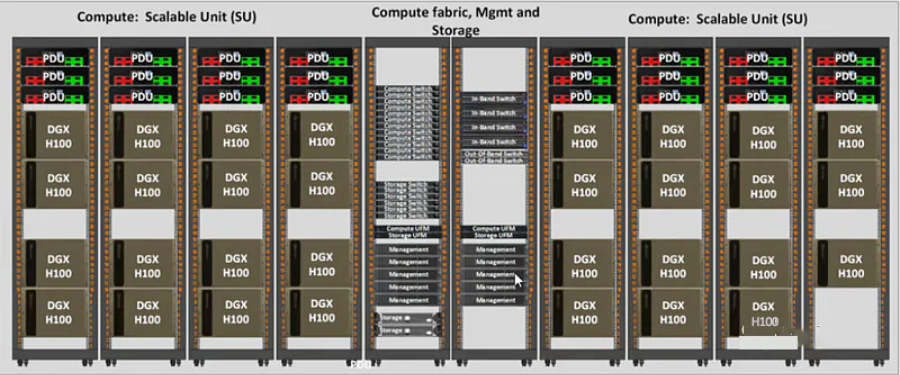

第四代NVIDIANVLink在全归约操作上提供了3倍的带宽提升,在7倍PCIeGen5带宽下,为多GPUIO提供了900GB/sec的总带宽,比上一代NVLink增加了50%的总带宽。第三代NVSwitch技术包括驻留在节点内部和外部的交换机,用于连接服务器、集群和数据中心环境中的多个GPU。节点内部的每个NVSwitch提供64个第四代NVLink链路端口,以加速多GPU连接。交换机的总吞吐率从上一代的。新的第三代NVSwitch技术也为多播和NVIDIASHARP网络内精简的集群操作提供了硬件加速。新的NVLinkSwitch系统互连技术和新的基于第三代NVSwitch技术的第二级NVLink交换机引入地址空间隔离和保护,使得多达32个节点或256个GPU可以通过NVLink以2:1的锥形胖树拓扑连接。这些相连的节点能够提供TB/sec的全连接带宽,并且能够提供难以置信的一个exaFlop(百亿亿次浮点运算)的FP8稀疏AI计算。PCIeGen5提供了128GB/sec的总带宽(各个方向上为64GB/s),而Gen4PCIe提供了64GB/sec的总带宽(各个方向上为32GB/sec)。PCIeGen5使H100可以与性能高的x86CPU和SmartNICs/DPU(数据处理单元)接口。H100 GPU 优惠促销,数量有限。russiaH100GPU总代

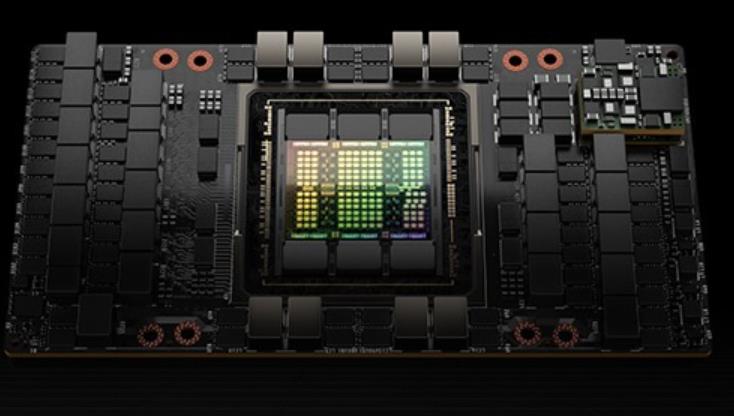

在大预言模型中达到9倍的AI训练速度和30倍的AI推理速度。HBM3内存子系统提供近2倍的带宽提升。H100SXM5GPU是世界上款采用HBM3内存的GPU,其内存带宽达到3TB/sec。50MB的L2Cache架构缓存了大量的模型和数据以进行重复访问,减少了对HBM3的重复访问次数。第二代多实例GPU(Multi-InstanceGPU,MIG)技术为每个GPU实例提供约3倍的计算能量和近2倍的内存带宽。次支持机密计算,在7个GPU实例的虚拟化环境中支持多租户、多用户配置。(MIG的技术原理:作业可同时在不同的实例上运行,每个实例都有的计算、显存和显存带宽资源,从而实现可预测的性能,同时符合服务质量(QoS)并尽可能提升GPU利用率。)新的机密计算支持保护用户数据,防御硬件和软件攻击,在虚拟化和MIG环境中更好的隔离和保护虚拟机。H100实现了世界上个国产的机密计算GPU,并以全PCIe线速扩展了CPU的可信执行环境。第四代NVIDIANVLink在全归约操作上提供了3倍的带宽提升,在7倍PCIeGen5带宽下,为多GPUIO提供了900GB/sec的总带宽。比上一代NVLink增加了50%的总带宽。第三代NVSwitch技术包括驻留在节点内部和外部的交换机,用于连接服务器、集群和数据中心环境中的多个GPU。xfusionH100GPU促销价近期 H100 GPU 的价格波动引起了关注。

交换机的总吞吐率从上一代的Tbits/sec提高到Tbits/sec。还通过多播和NVIDIASHARP网内精简提供了集群操作的硬件加速。加速集群操作包括写广播(all_gather)、reduce_scatter、广播原子。组内多播和缩减能提供2倍的吞吐量增益,同时降低了小块大小的延迟。集群的NVSwitch加速降低了用于集群通信的SM的负载。新的NVLink交换系统新的NVLINK网络技术和新的第三代NVSwitch相结合,使NVIDIA能够以前所未有的通信带宽构建大规模的NVLink交换系统网络。NVLink交换系统支持多达256个GPU。连接的节点能够提供TB的全向带宽,并且能够提供1exaFLOP的FP8稀疏AI计算能力。PCIeGen5H100集成了PCIExpressGen5×16通道接口,提供128GB/sec的总带宽(单方向上64GB/s),而A100包含的Gen4PCIe的总带宽为64GB/sec(单方向上为32GB/s)。利用其PCIeGen5接口,H100可以与性能高的x86CPU和SmartNICs/DPUs(数据处理单元)接口。H100增加了对本地PCIe原子操作的支持,如对32位和64位数据类型的原子CAS、原子交换和原子取指添加,加速了CPU和GPU之间的同步和原子操作H100还支持SingleRootInput/OutputVirtualization(SR-IOV)。

H100 GPU 支持新的 PCIe 4.0 接口,提供了更高的数据传输速度和带宽,与前代 PCIe 3.0 相比,带宽提升了两倍。这使得 H100 GPU 在与主机系统通信时能够更快速地交换数据,减少了 I/O 瓶颈,进一步提升了整体系统性能。PCIe 4.0 的支持使得 H100 GPU 能够与现代主流服务器和工作站更好地兼容,充分发挥其高性能计算能力。H100 GPU 也采用了多项创新技术。其采用了先进的风冷和液冷混合散热设计,能够在高负载运行时保持稳定的温度,确保 GPU 的长期稳定运行购买 H100 GPU 享受限时特价。

ITMALL.sale 以客户为中心,提供的技术支持和售后服务,确保客户在使用 H100 GPU 过程中无后顾之忧。ITMALL.sale 的技术团队由一群经验丰富、技术精湛的专业人员组成,能够为客户提供全天候的技术支持。无论客户在使用过程中遇到任何问题,ITMALL.sale 都能够迅速响应,提供解决方案。ITMALL.sale 还提供定制化服务,根据客户的具体需求,以及设计和优化 H100 GPU 解决方案,确保客户能够充分利用 H100 GPU 的强大性能,提升工作效率和业务竞争力。H100 GPU 在云计算中的应用也非常多。硬盘H100GPU总代

H100 GPU 提供高效的功耗管理。russiaH100GPU总代

然后剩余的总共大约6个月。初创公司是否从OEM和经销商处购买?#没有。初创公司通常会去像甲骨文这样的大型云租用访问权限,或者像Lambda和CoreWeave这样的私有云,或者与OEM和数据中心合作的提供商,如FluidStack。初创公司何时构建自己的数据中心与进行托管?#对于构建数据中心,考虑因素是构建数据中心的时间,您是否具有硬件方面的人员和经验,以及它的资本支出是否昂贵。更容易租用和colo服务器。如果你想建立自己的DC,你必须在你所在的位置运行一条暗光纤线路来连接到互联网-每公里10万美元。大部分基础设施已经在互联网繁荣期间建成并支付。现在你可以租它,相当便宜–私有云执行官从租赁到拥有的范围是:按需云(使用云服务的纯租赁),保留云,colo(购买服务器,与提供商合作托管和管理服务器),自托管(自己购买和托管服务器)。大多数需要大量H100的初创公司将进行保留云或colo。大云如何比较?#人们认为,Oracle基础架构不如三大云可靠。作为交换,甲骨文会提供更多的技术支持帮助和时间。100%.一大堆不满意的客户,哈哈–私有云执行官我认为[甲骨文]有更好的网络–(不同)私有云高管一般来说,初创公司会选择提供支持、价格和容量的佳组合的人。russiaH100GPU总代

- 技嘉H100GPU货期 2024-11-15

- 硬盘H100GPU优惠 2024-11-15

- Dubai戴尔H100GPU 2024-11-15

- LenovoH100GPU distributor 2024-11-15

- 北京H100GPU 2024-11-15

- 英伟达H100GPU货期 2024-11-15

- NVLINKH100GPU list price 2024-11-14

- QatarH100GPU stock 2024-11-14

- 河南H100GPU库存 2024-11-14

- 广东H100GPU 2024-11-14

- 技嘉H100GPU多少钱 2024-11-14

- CPUH100GPU多少钱 2024-11-14